Adobe Character Animator : guide complet de l’animation de personnages en temps réel en 2025

Dans l’écosystème créatif d’Adobe, Character Animator s’est imposé comme une solution révolutionnaire pour l’animation de personnages. Ce logiciel unique combine capture de mouvements en temps réel, synchronisation labiale automatique et animation procédurale pour offrir aux créateurs un flux de travail d’une efficacité sans précédent. Que vous soyez animateur professionnel, créateur de contenu digital ou enseignant cherchant à produire des présentations dynamiques, découvrez comment Character Animator transforme l’art de donner vie aux illustrations.

Qu’est-ce qu’Adobe Character Animator ?

Adobe Character Animator est un logiciel d’animation spécialisé qui permet de créer des animations de personnages en temps réel à partir d’illustrations statiques. Contrairement aux méthodes d’animation traditionnelles qui nécessitent de dessiner chaque image individuellement, Character Animator capture les mouvements de l’utilisateur via webcam, les expressions faciales et la voix pour animer instantanément des personnages 2D.

Lancé initialement en 2015 comme une fonctionnalité bêta d’After Effects, Character Animator a rapidement évolué en une application autonome de la suite Adobe Creative Cloud. Sa capacité unique à produire des animations en temps réel l’a rapidement rendu populaire dans l’industrie du broadcast, notamment pour des émissions comme « The Simpsons » et « The Late Show with Stephen Colbert » qui l’ont utilisé pour des segments en direct.

Principes fondamentaux de Character Animator

Animation par capture de performance

Le concept central de Character Animator repose sur la capture de performance :

- Tracking facial : La webcam détecte et suit les expressions faciales de l’utilisateur

- Synchronisation labiale : Analyse automatique de l’audio pour synchroniser les mouvements de bouche

- Contrôles par clavier/souris : Déclenchement de mouvements et d’actions prédéfinies

- Interactions physiques : Simulation de comportements réalistes pour les éléments du personnage

Cette approche transforme l’animation en une forme de performance, permettant même aux débutants de créer rapidement des animations expressives sans expertise technique approfondie.

Workflow intégré avec Adobe Illustrator et Photoshop

Character Animator fonctionne en étroite collaboration avec d’autres applications Adobe :

- Les personnages sont généralement conçus dans Adobe Illustrator ou Photoshop

- Les illustrations sont structurées en calques spécifiques pour identifier les éléments mobiles

- Le format de fichier .puppet conserve la structure hiérarchique des calques

- Les animations finalisées peuvent être exportées vers After Effects ou Premiere Pro pour l’intégration dans des projets plus complexes

Cette intégration transparente dans l’écosystème Adobe Creative Cloud constitue l’un des principaux avantages du logiciel.

Applications pratiques de Character Animator

Character Animator trouve sa place dans de nombreux domaines créatifs :

Animation et broadcast

- Segments animés en direct : Productions télévisuelles nécessitant des réactions en temps réel

- Webséries animées : Production accélérée d’épisodes avec un minimum d’animateurs

- Animatiques : Prévisualisation rapide de séquences pour productions plus élaborées

- Courts métrages : Création complète d’animations narratives avec ressources limitées

Contenus digitaux et streaming

- Avatars pour streamers : Personnages animés réagissant en temps réel sur Twitch, YouTube Live

- Vidéos éducatives : Présentateurs virtuels pour contenus pédagogiques

- Vlogs animés : Alternative créative aux vidéos traditionnelles

- Réseaux sociaux : Contenus innovants pour TikTok, Instagram et autres plateformes

Domaines professionnels et éducatifs

- Formations interactives : Tuteurs virtuels pour l’e-learning

- Présentations d’entreprise : Alternative engageante aux diaporamas classiques

- Marketing digital : Mascotes de marque animées pour campagnes publicitaires

- Prototypage d’interfaces : Animation rapide pour tester l’UX des applications et jeux

Fonctionnalités clés de Character Animator

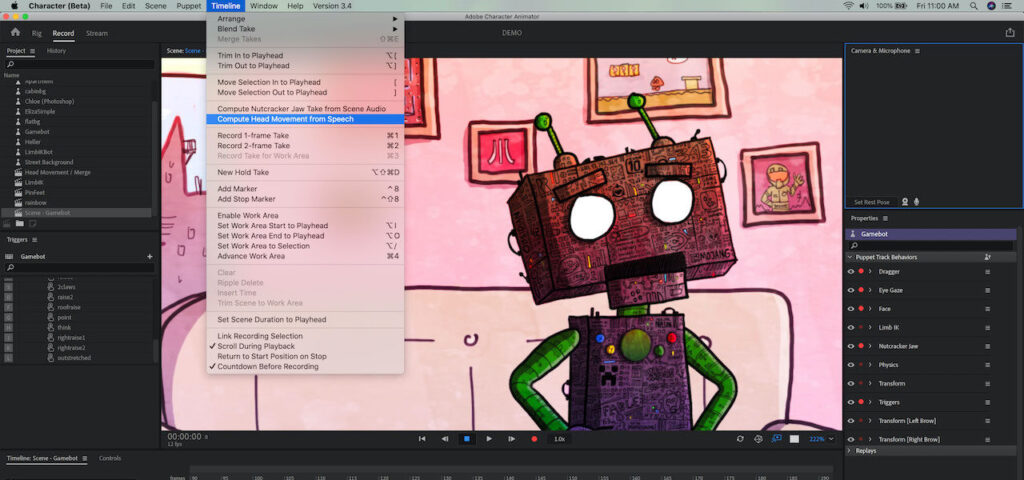

Outils de capture et performance

- Face Tracker : Capture précise des expressions faciales via webcam

- Audio Triggers : Détection des phonèmes pour synchronisation labiale automatique

- Keyboard Triggers : Déclenchement d’animations prédéfinies via raccourcis clavier

- Drap-and-drop Behaviors : Ajout rapide de comportements physiques et d’interactions

Animation procédurale

- Moteur physique : Simulation réaliste des cheveux, vêtements et autres appendices

- Behaviors : Animations automatiques pour marche, respiration, clignements, etc.

- Eye Tracking : Suivi naturel du regard avec points d’intérêt

- Cycle Layers : Séquences d’images pour animations complexes et répétitives

Environnement et compositing

- Scènes multiples : Organisation de plusieurs personnages et décors

- Camera : Contrôles de caméra pour mouvements et zooms

- Effets intégrés : Particules, distorsions et autres effets visuels

- Calques d’ajustement : Modifications globales de l’apparence et du timing

Exportation et intégration

- Rendu multi-formats : Export en vidéo, séquence d’images ou animation pour After Effects

- Streaming en direct : Sortie vidéo en temps réel pour diffusion

- Character Animator Live Link : Intégration avec Adobe Aero pour AR

- Format de projet collaboratif : Partage de productions entre équipes

Character Animator vs autres logiciels d’animation

Character Animator vs CrazyTalk Animator

CrazyTalk (désormais Cartoon Animator) propose également de l’animation faciale, mais avec une approche différente. Character Animator excelle dans l’animation en temps réel et l’intégration avec l’écosystème Adobe, tandis que Cartoon Animator offre davantage de templates prédéfinis et une courbe d’apprentissage potentiellement moins abrupte pour les débutants.

Character Animator vs Toon Boom Harmony

Toon Boom Harmony reste la référence en animation 2D traditionnelle avec des outils de dessin et d’animation frame-by-frame sophistiqués. Character Animator se distingue par sa capture de performance en temps réel, idéale pour les productions nécessitant rapidité et réactivité, tandis que Harmony convient mieux aux animations soigneusement élaborées image par image.

Character Animator vs Live2D

Live2D s’est spécialisé dans l’animation de personnages « 2.5D » principalement pour les jeux et applications, avec un accent particulier sur l’esthétique anime. Character Animator offre une approche plus universelle et une meilleure intégration avec les workflows de production vidéo, mais peut être moins adapté aux projets nécessitant l’esthétique et les déformations spécifiques de Live2D.

Configuration matérielle recommandée

Pour utiliser Character Animator 2025 de manière optimale, voici la configuration recommandée :

Configuration minimale

- Processeur : Intel 6e génération ou AMD équivalent, 4 cœurs minimum

- RAM : 16 Go

- Stockage : SSD avec 2 Go d’espace disponible

- Carte graphique : GPU compatible avec 2 Go VRAM

- Webcam : Caméra HD 720p minimum

- Micro : Microphone de qualité pour capture audio

Configuration optimale

- Processeur : Intel i7/i9 12e génération ou AMD Ryzen 7/9

- RAM : 32 Go

- Stockage : SSD NVMe avec 4 Go d’espace disponible

- Carte graphique : NVIDIA RTX série 30/40

- Webcam : Caméra 4K ou webcam professionnelle

- Micro : Microphone à condensateur avec interface audio

- Éclairage : Source lumineuse uniforme pour tracking facial optimal

Préparation des personnages pour Character Animator

La création de personnages adaptés à Character Animator nécessite une approche spécifique :

Structure de calques optimale

Un personnage (puppet) bien organisé facilite l’animation :

- Organisation hiérarchique : Structure parent-enfant logique pour les articulations

- Nomenclature standardisée : Utilisation des tags reconnus par Character Animator (Head, Right Arm, etc.)

- Séparation des éléments : Bouche, yeux, sourcils sur des calques distincts

- Considérations d’ancrage : Points de pivot correctement placés pour mouvements naturels

Workflow depuis Illustrator

Le processus de création dans Adobe Illustrator suit généralement ces étapes :

- Conception du personnage avec toutes ses parties sur des calques séparés

- Organisation et nomination des calques selon les conventions Character Animator

- Exportation en fichier .ai ou directement en .puppet

- Importation et configuration dans Character Animator

Rigging automatique vs personnalisé

Character Animator offre deux approches pour le rigging :

- Auto-rigging : Identification automatique des éléments du visage et du corps

- Rigging manuel : Configuration précise des comportements et contraintes pour un contrôle maximal

Les projets professionnels combinent généralement les deux approches pour un équilibre entre efficacité et contrôle.

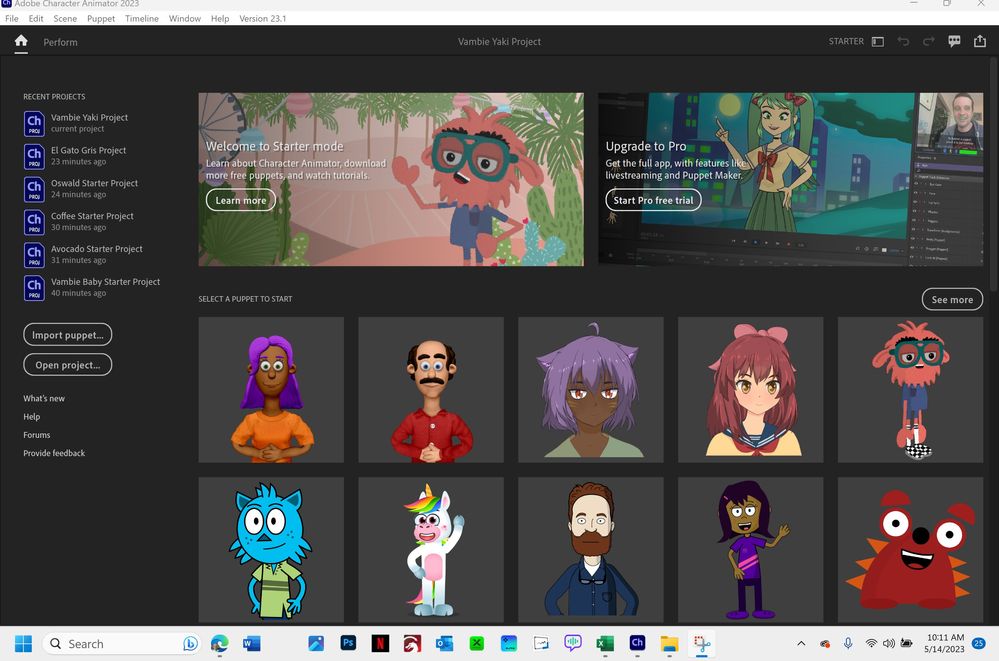

Formation et apprentissage

Pour maîtriser Character Animator, plusieurs ressources sont disponibles :

Ressources officielles Adobe

- Adobe Learn : Tutoriels officiels couvrant les bases et techniques avancées

- Documentation Adobe : Guide complet des fonctionnalités et procédures

- Communauté Character Animator : Forum d’utilisateurs pour partage et entraide

Formations en ligne

- Cours spécialisés sur LinkedIn Learning, Udemy et autres plateformes

- Chaînes YouTube dédiées à l’animation de personnages

- Webinaires et workshops avec des professionnels

Exemples et templates

Adobe propose également :

- Personnages préconfiguré pour démarrer rapidement

- Projets d’exemple pour comprendre les techniques avancées

- Bibliothèque de comportements et expressions réutilisables

Workflow professionnel avec Character Animator

Voici les étapes typiques d’un projet d’animation avec Character Animator :

- Conception du personnage dans Illustrator ou Photoshop

- Préparation et rigging du personnage dans Character Animator

- Enregistrement des performances (expressions faciales, voix, mouvements)

- Ajustement et raffinement des animations capturées

- Ajout d’effets et comportements supplémentaires

- Exportation vers After Effects ou Premiere Pro pour post-production

- Publication sur les plateformes cibles (web, broadcast, médias sociaux)

Intégration avec l’écosystème Adobe

Character Animator s’intègre parfaitement avec d’autres logiciels Adobe :

- Illustrator/Photoshop : Création et modifications des personnages

- After Effects : Post-production et effets spéciaux

- Premiere Pro : Montage et intégration dans des projets vidéo plus larges

- Media Encoder : Exportation optimisée pour différentes plateformes

- Audition : Traitement audio avancé pour les dialogues

- Adobe Aero : Exportation pour expériences en réalité augmentée

Tarification et licences

Adobe Character Animator est disponible via différentes formules d’abonnement Creative Cloud :

- Character Animator seul : Option d’abonnement individuel

- Formule complète Creative Cloud : Accès à toutes les applications Adobe

- Formule entreprise : Solutions adaptées aux équipes et organisations

- Formule éducation : Tarifs réduits pour étudiants et enseignants

Questions fréquentes

Character Animator convient-il aux débutants en animation ?

Oui, c’est l’un des points forts du logiciel. Contrairement à l’animation traditionnelle qui nécessite des années de formation, Character Animator permet aux débutants de produire rapidement des animations expressives grâce à la capture de performance. Les principes fondamentaux sont accessibles en quelques heures, même si la maîtrise des techniques avancées demande plus de pratique.

Peut-on créer des animations professionnelles avec Character Animator ?

Absolument. Malgré sa simplicité apparente, Character Animator est utilisé dans des productions télévisuelles majeures, notamment pour des segments animés en direct. Sa capacité à produire des animations expressives rapidement en fait un outil précieux même dans des workflows professionnels. Pour des résultats de niveau broadcast, il est généralement intégré avec After Effects pour la finition.

Faut-il nécessairement utiliser une webcam avec Character Animator ?

Bien que la capture faciale soit une fonctionnalité phare du logiciel, elle n’est pas obligatoire. Character Animator permet également l’animation via contrôles manuels, déclencheurs audio ou keyframes traditionnelles. Cependant, pour exploiter pleinement le potentiel du logiciel, une webcam de bonne qualité avec un éclairage adéquat est recommandée.

Conclusion

Adobe Character Animator a redéfini les possibilités de l’animation 2D en démocratisant ce médium autrefois réservé aux spécialistes. Sa capacité unique à transformer les expressions faciales et la voix en animations instantanées ouvre des possibilités créatives inédites pour les créateurs de contenu, animateurs et communicants.

En 2025, ce logiciel continue d’évoluer avec des fonctionnalités IA qui rendent l’animation de personnages encore plus accessible et expressive. Que vous soyez un studio d’animation cherchant à optimiser votre production, un créateur de contenu digital souhaitant se démarquer, ou un professionnel de la communication voulant dynamiser vos présentations, Character Animator offre une solution puissante parfaitement intégrée dans l’écosystème Adobe.